- Outeur Miles Stephen stephen@answers-science.com.

- Public 2023-12-15 23:33.

- Laas verander 2025-01-22 16:55.

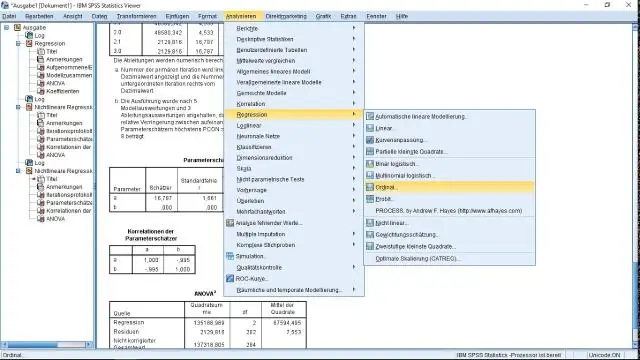

Normale vergelyking is 'n analitiese benadering tot Lineêre regressie met 'n Minste Vierkante Koste-funksie. Ons kan die waarde van θ direk uitvind sonder om Gradient Descent te gebruik. Om hierdie benadering te volg is 'n effektiewe en tydbesparende opsie wanneer daar met 'n datastel met klein kenmerke gewerk word.

Ook, wat is 'n normale vergelyking?

Normale vergelykings is vergelykings verkry deur die parsiële afgeleides van die som van kwadraatfoute (kleinste kwadrate) gelyk aan nul te stel; normale vergelykings laat 'n mens toe om die parameters van 'n meervoudige lineêre regressie te skat.

'n Mens kan ook vra, wat is kostefunksie vir lineêre regressie? Koste funksie MSE meet die gemiddelde kwadraatverskil tussen 'n waarneming se werklike en voorspelde waardes. Die uitset is 'n enkele getal wat die koste , of telling, wat verband hou met ons huidige stel gewigte. Ons doel is om MSE te minimaliseer om die akkuraatheid van ons model te verbeter.

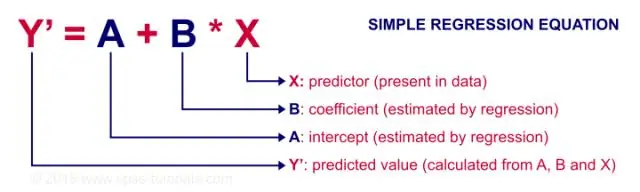

Weet ook, wat is die vergelyking van lineêre regressie?

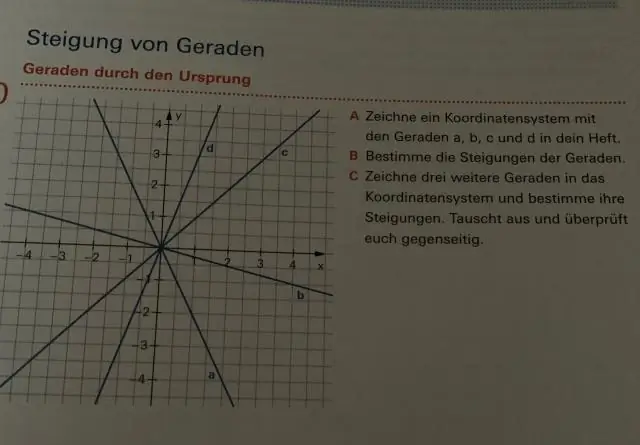

Lineêre regressie . A Lineêre regressie lyn het 'n vergelyking van die vorm Y = a + bX, waar X die verklarende veranderlike is en Y die afhanklike veranderlike is. Die helling van die lyn is b, en a is die snysnit (die waarde van y wanneer x = 0).

Wat is die normaal van 'n kromme?

Die normaal na die kromme is die lyn loodreg (teen regte hoeke) op die raaklyn aan die kromme op daai punt. Onthou, as twee lyne loodreg is, is die produk van hul gradiënte -1.

Aanbeveel:

Wat is lineêre regressie in R-programmering?

Lineêre regressie word gebruik om die waarde van 'n kontinue veranderlike Y te voorspel gebaseer op een of meer insetvoorspellerveranderlikes X. Die doel is om 'n wiskundige formule tussen die die responsveranderlike (Y) en die voorspellerveranderlikes (Xs) daar te stel. Jy kan hierdie formule gebruik om Y te voorspel, wanneer slegs X-waardes bekend is

Hoe bereken jy nie-lineêre regressie?

As jou model 'n vergelyking in die vorm Y = a0 + b1X1 gebruik, is dit 'n lineêre regressiemodel. Indien nie, is dit nie-lineêr. Y = f(X,β) + ε X = 'n vektor van p voorspellers, β = 'n vektor van k parameters, f(-) = 'n bekende regressiefunksie, ε = 'n foutterm

Waarvoor word nie-lineêre regressie gebruik?

Nie-lineêre regressie is 'n vorm van regressie-analise waarin data by 'n model pas en dan as 'n wiskundige funksie uitgedruk word. Nie-lineêre regressie gebruik logaritmiese funksies, trigonometriese funksies, eksponensiële funksies, magsfunksies, Lorenz-krommes, Gaussiese funksies en ander passingsmetodes

Kan ons regressie op nie-lineêre data uitvoer?

Nie-lineêre regressie kan baie meer tipes krommes pas, maar dit kan meer moeite verg om beide die beste passing te vind en om die rol van die onafhanklike veranderlikes te interpreteer. Daarbenewens is R-kwadraat nie geldig vir nie-lineêre regressie nie, en dit is onmoontlik om p-waardes vir die parameterskattings te bereken

Wanneer moet jy korrelasie gebruik en wanneer moet jy eenvoudige lineêre regressie gebruik?

Regressie word hoofsaaklik gebruik om modelle/vergelykings te bou om 'n sleutelrespons, Y, te voorspel vanaf 'n stel voorspeller (X) veranderlikes. Korrelasie word hoofsaaklik gebruik om die rigting en sterkte van die verwantskappe tussen 'n stel van 2 of meer numeriese veranderlikes vinnig en bondig op te som